3D-Scan & 3D-Drucker: So druckst du dich selbst (Teil 1)

Du hast bereits einen 3D-Drucker oder spielst mit dem Gedanken dir einen zu kaufen? Du willst echte Gegenstände „klonen“? Den ganzen Körper deines/deiner Freund(in) duplizieren? Du interessierst dich dafür, wie man selbst 3D-Scans erstellt (und diese im Nachgang ausdruckt)? Dieser 3D-Scan-Ratgeber zeigt es dir mit praktischen Beispielen. Du wirst überrascht sein, der Workflow ist relativ leicht umsetzbar und günstig!

Vorab: Dieser Ratgeber ist etwas länger und das Scannen lässt sich an manchen Stellen deutlich besser in bewegten Bildern zeigen, deswegen gibt es hier meinen 3D-Scan-Ratgeber auch auf YouTube. Dort gehe ich Step-by-Step jeden Schritt durch.

Geht das im Video mal zu schnell, oder ihr wollt bequem die Links klicken findet ihr hier alles (und ein bisschen mehr) in Textform.

Vorbereitung: Was brauche ich an Hard- und Software?

Auch wenn z.B. das iPhone inzwischen Tiefensensoren verbaut hat und die ersten Beta-Apps 3D-Scans ermöglichen, so ist doch ältere Hardware noch ziemlich beliebt. Wir nehmen für dieses Tutorial den „alten“ Xbox 360 Kinect Sensor (nicht die neuere Version). Das hat zwei wichtige Vorteile:

- Der Preis für den alten Kinect-Sensor liegt bei 10-30€ – je nach Verhandlungsgeschick bei ebay-kleinanzeigen

- Das SDK (d.h. die „Software-Umgebung“) ist offen zugänglich und so gibt es verschiedene Software für 3D-Scans

Es gibt auch andere Hardware, wie z.B. den neuen Kinect Sensor (dafür gibt es kaum Software), den Asus Xtion Pro Live (teuer) oder Primesense Carmine 08 Sensor (teuer). Klar, der Kinect 360 Sensor ist etwas älter: Das merkt man vor allem an der Farbauflösung, die für unsere 3D-Drucke natürlich aber auch völlig egal ist. Aufrüsten kann man immer noch!

Beachte: Es gibt auch (komplett!) andere Herangehensweisen/Scan-Techniken, wie z.B. die Photogrammetrie bei der aus duzenden bis tausenden Einzelbildern Übereinstimmungen extrahiert, verknüpft und so 3D-Modelle erstellt werden. Dafür reicht prinzipiell jede Smartphone-Kamera, allerdings ist der Aufwand in der Nachbearbeitung und die benötigte Rechenleistung jedoch erheblich höher. Dennoch bietet sich die Photogrammetrie z.B. für kostengünstige, große, Landschafts-Scans an.

Zudem ist eine halbwegs aktuelle Grafikkarte von ATI oder nvidia förderlich. Wird OpenGL bzw. OpenCL bzw. CUDA unterstützt kann die GPU die späteren, sehr rechenintensiven Aufgaben übernehmen. Andernfalls wird nur die CPU arbeiten und das errechnen der Netze, das Kompensieren, etc wird Stunden (ja wirklich Stunden!) dauern.

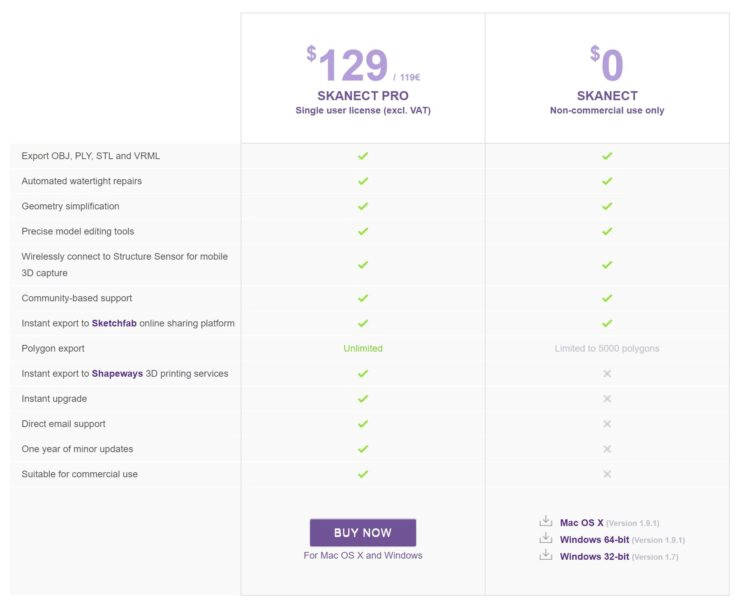

Als Software kommt in meinen Beispielen Skanect (1.9.1 Pro) zum Einsatz. Die Vorteile hier sind:

- Es ist kinderleicht zu bedienen

- Die Ergebnisse sind (mit) die besten

- Es gibt auch eine kostenlose non-commercial Version (ist aber auf 5000 Polygone beschränkt)

Ich scanne viel und habe mir vor etwa einem Jahr die Pro-Version für umgerechnet 110€ gekauft. Das ist eine Menge Kohle, ich bereue es aber keine Sekunde. (Naja OK, doch, direkt beim Kaufvorgang ;-)).

Auch bei der Software möchte ich euch dennoch Alternativen mitgeben: So ist z.B. K-Scan oder ReconstructMe für euch eher passend. Egal welche Software du nutzt, wenn du dich unter Windows dreidimensional scannen möchtest, brauchst du noch das Kinect for Windows SDK (Version 1.8).

Das Setup: Vorbereitung für den 3D-Scan

Was möchtest du überhaupt scannen? Je nachdem empfehlen sich verschiedene Aufbau-Szenarien:

- kleine bis mittlere Objekte

- Körper oder Köpfe

- Räume, Raumteilstücke oder Flächen

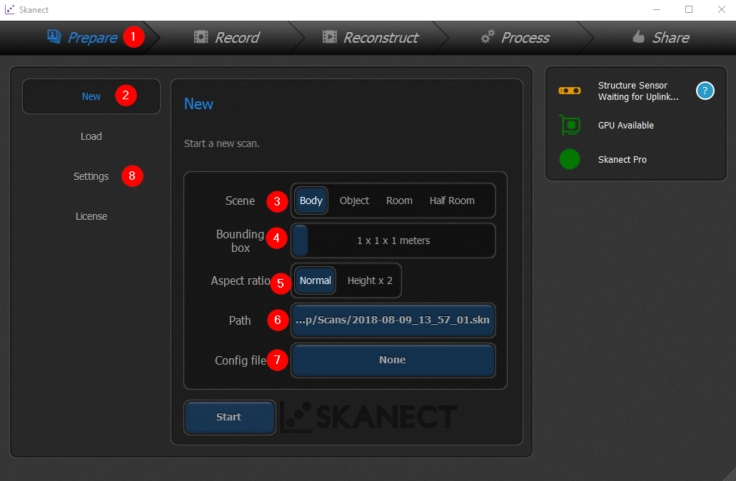

Passender Weise ist das auch der erste Schritt in Skanect: Wir müssen festlegen, was wir scannen wollen.

- Tab Vorbereitung

- Neuer Scan

- Welche Szene/Szenario

- Wie groß soll die zu scannende Box sein? (Das Objekt sollte „rein passen“ zzgl. Toleranz – dazu später mehr)

- Das Verhältnis der Box. Ein Kopf ist z.B. höher als breit

- Wo soll der Scan abgelegt werden

- Soll eine gespeicherte Konfiguration geladen werden (dann ist Schritt 8 hinfällig)

- Wir können und sollten weitere Einstellungen vornehmen (siehe folgenden Screenshot)

Oben rechts erkennst du übrigens, ob und welche Hardware erkannt wurde. In meinem Fall wird noch auf den „Structure Sensor“ (d.h. den Kinect Sensor) gewartet, eine bessere GPU wurde erkannt und ich verwende Skanect Pro.

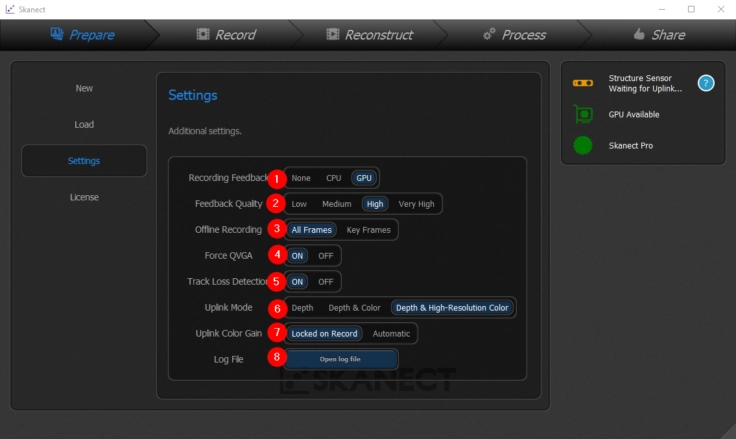

- Habt ihr eine aktuelle GPU? Dann GPU wählen

- Wie gut/schnell/genau/“scharf“ soll das Feedback während des Scans sein

- Stimmt die Performance, sollte man alle Frames offline aufzeichnen

- Höhere Auflösung erzwingen

- Falls man sich zu schnell bewegt und der Scan den „Anknüpfpunkt“ verliert, muss man zurückkehren

- Was soll aufgezeichnet werden? Tiefen? Tiefen und Farben?

- …

- Der Scan wird mitprotokolliert. Fürs spätere Debuggen ist der Aufbewahrungsort einzustellen

So gelingt der Scanvorgang

Auch hier sollte man sich das Video von mir anschauen. Damit das eigentliche Scannen vernünftig, schnell und fehlerfrei klappt, sind hier meine Tipps:

- Wenn deine PC-Performance zu schwach ist: Dreh unbedingt die Feedback-Qualität herunter

- Wenn du dich selbst scannst: Sitze aufrecht und drehe dich möglichst exakt um deine vorgestellte Achse. „Eier nicht herum“.

- Sitze aufrecht. Brust hoch, Bauch rein, Schultern nach hinten. Wie es dir dein Arzt sag. Hebe den Kopf ein bisschen hoch.

- Haare sind fies! Hast du lange Haare binde sie zusammen, mach einen Dutt, oder Pferdeschwanz. „Zerzauste Frisuren“ sind extrem schwer scanbar.

- Du kannst keine durchsichtigen Gegenstände (jap, das ist auch eine Brille!) oder reflektierenden Oberflächen (Sticker auf deinem Cap!) scannen.

- Starte den Scan deines Kopfes immer von hinten. Hast du dich um 360 Grad gedreht und die Oberflächen werden leicht falsch verknüpft ist das nicht schlimm.

- Es gibt wenige, die Bekommen das Scannen direkt beim Start auch mit einem schnellen „Wisch“ über das Gesicht hin – probiert es aus.

- Wenn du Wert auf die Textur legst, sorge für eine gleichmäßige Ausleuchtung (min. drei Studiolichter) oder draußen bei Nebel

Testet das Scannen mehrmals vorab. Werdet mit der Software warm. Beim eigentlichen Scanvorgang solltet ihr eine Framerate von 30fps erreichen, damit z.B. die „Track Loss Detection“ vernünftig funktioniert. Ruckelt euer Scan, d.h. die Framerate ist unter 25 fps, hilft es meist die Qualität zu reduzieren. Zudem sollten natürlich alle Hintergrundprogramme geschlossen werden.

Wichtig: Je mehr Mühe ihr euch beim eigentlichen Scan macht, desto weniger Zeit müsst ihr in der Nachbearbeitung investieren. Hier lassen sich Stunden an mühsamer Arbeit sparen.

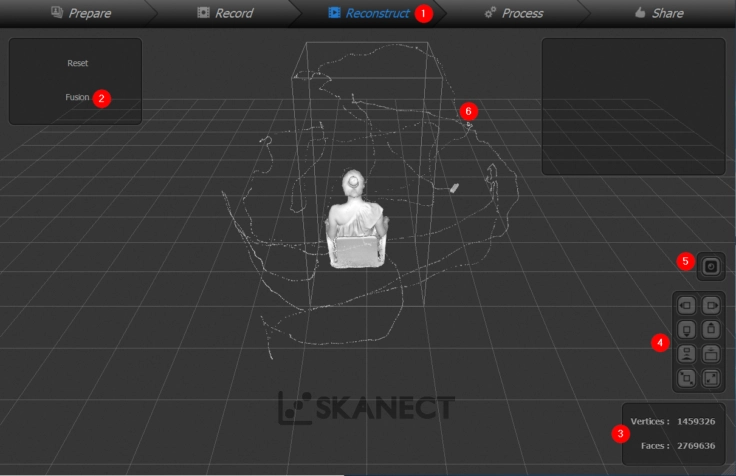

Nach dem Scan könnt ihr unter Reconstruct/Fusion versuchen fehlende Elemente zu rekonstruieren. Ihr habt hoffentlich, wie ich im Video, Hilfe gehabt, sodass dieser Schritt nicht mehr nötig ist.

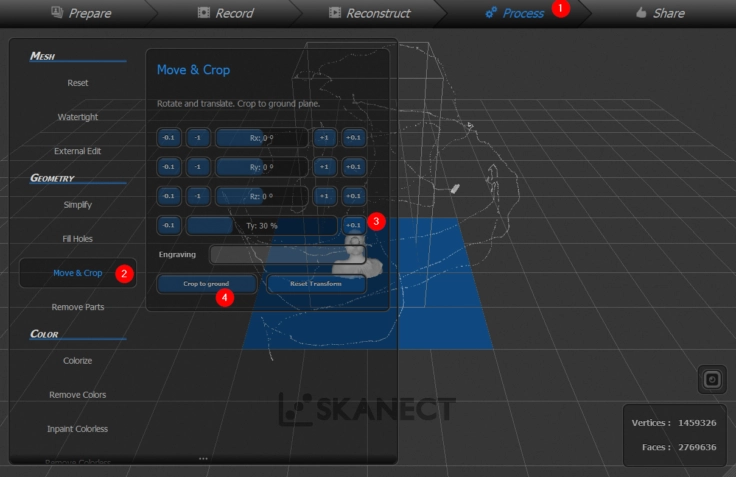

Im Nachgang könnt ihr unter „Process“ euren Scan zuschneiden, Löcher füllen, die Farbtextur auflegen und reparieren und weitere diverse Kleinigkeiten anpassen.

Ihr solltet euer Werk jedoch nicht „simplifien“, d.h. u.A. Eckpunkte entfernen, da man nie weiß, wie hoch man den Scan später einmal skalieren möchte.

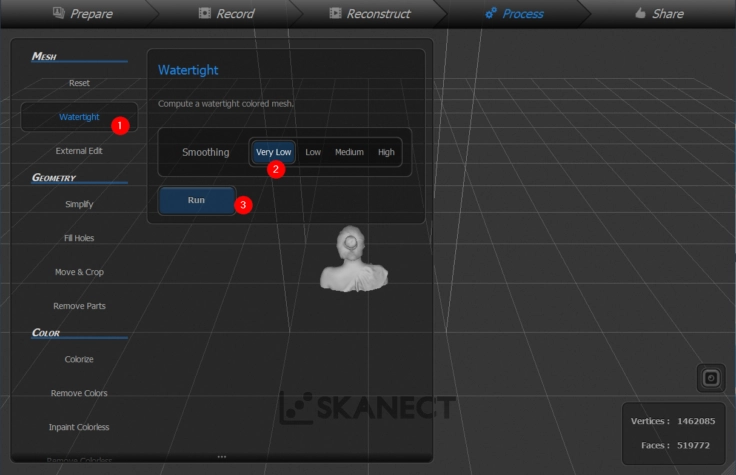

Ein wichtiger Schritt, der so oder so abgeschlossen werden sollte, ist das „watertightening“, d.h. euer Objekt wasserdicht zu gestalten. Wasser was theoretisch im Objekt wäre, darf nicht heraus- bzw. hereinfließen. Erst dann haben wir eine geschlossene Hülle.

Abschließend gilt es unter dem Menüpunkt „Share“ euer Objekt als .STL (oder z.B. auch als .OBJ) zu exportieren und dann mit eurem Slicer der Wahl zu importieren. Wer sich hier noch etwas unsicher ist, wie STL zu GCODE wird, kann sich meinen Ratgeber „3D-Drucker: Mit dem Slicer von STL zu GCODE (Idee zum Druck)“ durchlesen, oder sich mein YouTube-Tutorial ansehen – darauf gehe ich abschließend ein.

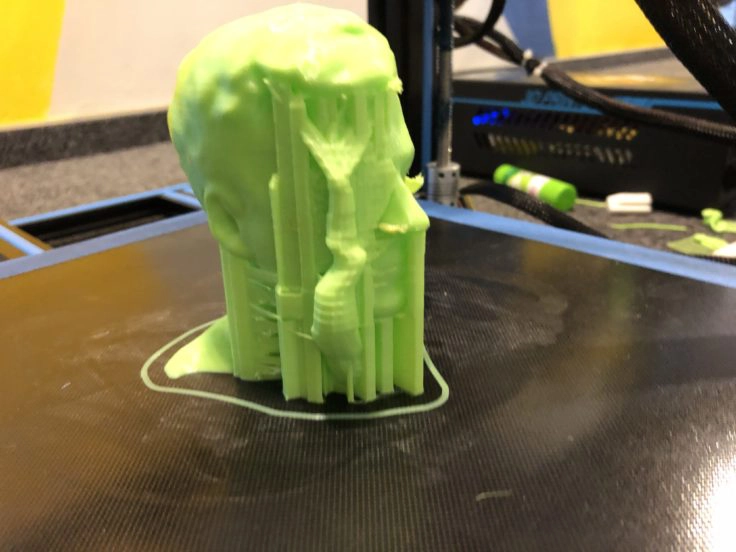

Wichtig ist die passende Stützstruktur (es lohnt sich in neueren Cura-Versionen auch mal den Tree-Support) auszuwählen und für die erste Version reicht auch die Draft-Qualität mit 0,2mm Layerheight.

Fertig! 🙂

Dieser Ratgeber ist gerade in Überarbeitung bzw. wird aktualisiert.

Sortierung: Neueste | Älteste

Kommentare (18)